Stable Virtual Camera من Stability AI: توليد فيديو 3D من صورك مجانًا

كشفت شركة Stability AI عن نموذج ذكاء اصطناعي جديد يحمل اسم «Stable Virtual Camera».

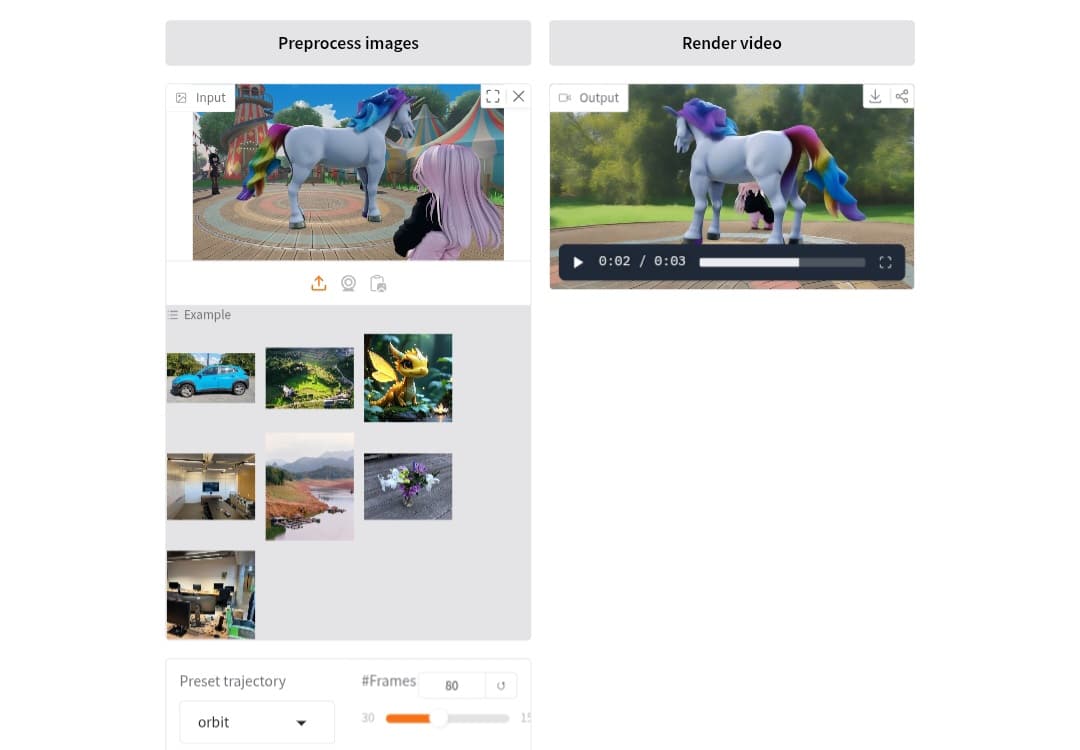

وهو أداة بحثية قادرة على تحويل الصور العادية إلى مشاهد فيديو ثلاثية الأبعاد بتفاصيل واقعية وتحكم متقدم بحركة الكاميرا.

وبالتالي إنتاج مشاهد متحركة تبدو واقعية وغنية بالتفاصيل، دون الحاجة إلى معدات تصوير متقدمة أو عمليات معالجة معقدة.

كيف تعمل Stable Virtual Camera

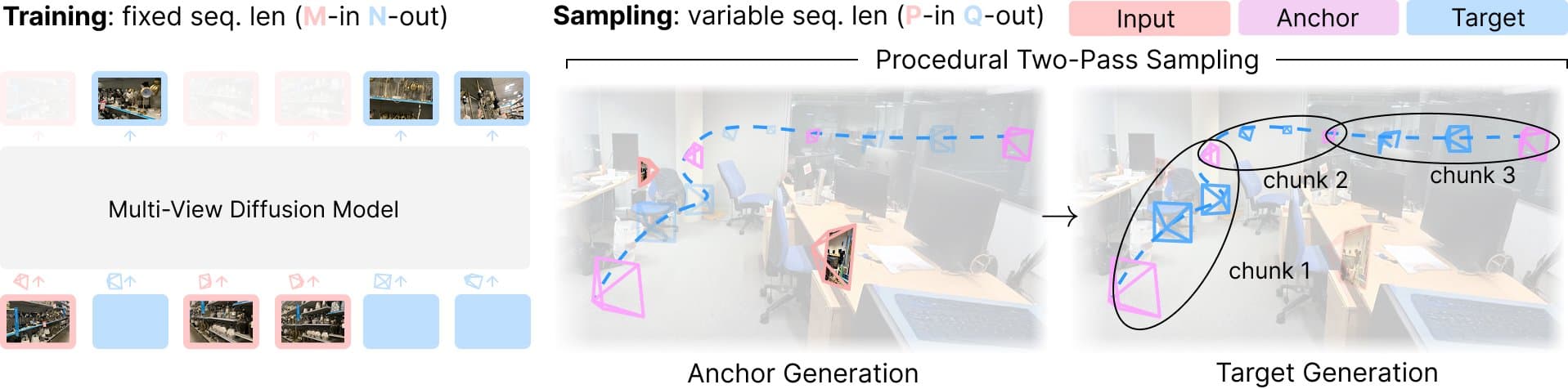

تعتمد الأداة على نموذج توليدي يعتمد على ما يُعرف بالـ «multi-view diffusion».

وهي تقنية تسمح بإنشاء لقطات جديدة لمشاهد ثابتة من زوايا متعددة، وفقًا للمسار الذي يحدده المستخدم لحركة الكاميرا.

ويمكن للنموذج توليد مشاهد انسيابية بأبعاد ثلاثية بناءً على صورة واحدة فقط أو حتى 32 صورة كحد أقصى.

كما تدعم مسارات حركة متنوعة مثل: التدوير 360 درجة، والانتقال الأمامي والخلفي، والحركة الحلزونية، والزوم الديناميكي، وغيرها.

وتمثل Stable Virtual Camera تطورًا لافتًا مقارنة بالأساليب التقليدية التي تتطلب غالبًا مجموعات ضخمة من الصور أو عمليات معالجة هندسية لإعادة بناء المشهد.

فبدلاً من ذلك، تقوم الأداة بتوليد فيديوهات متكاملة تتسم بالثبات البصري والانتقال السلس بين الزوايا، حتى في الفيديوهات الطويلة التي قد تصل إلى 1000 إطار.

ويمكن للنموذج إنتاج فيديوهات بأحجام متعددة مثل المربع (1:1) والطولي (9:16) والأفقي (16:9)، دون الحاجة إلى تدريب إضافي أو تهيئة خاصة.

وبهذا تصبح مناسبة لمختلف الاستخدامات سواء على منصات التواصل الاجتماعي أو في مشاريع إنتاج المحتوى.

لكن نبهت الشركة إلى بعض القيود التي تواجه النسخة الحالية، مثل تراجع جودة النتائج عند التعامل مع صور تحتوي على أشخاص أو حيوانات أو عناصر طبيعية متغيرة مثل المياه.

كما أن بعض المشاهد المعقدة أو الحركات الحادة التي تمر عبر الأجسام قد تسبب اهتزازات في الصورة، خصوصًا عندما تختلف الزوايا المستهدفة كثيرًا عن الصور الأصلية.

كيفية الوصول

أفادت Stability AI أن الأداة متاحة حاليًا لأغراض بحثية فقط بموجب ترخيص غير تجاري.

ويمكن تحميلها من منصة Hugging Face إلى جانب الشيفرة المصدرية على GitHub.

وهي أيضًا متاحة للتجربة المجانية عبر منصة هاجنج فيس.

وتشير الشركة إلى أن Stable Virtual Camera حققت نتائج متفوقة عند اختبارها في مقاييس توليد المشاهد ثلاثية الأبعاد، مقارنة بنماذج أخرى مثل ViewCrafter وCAT3D، سواء في سيناريوهات الزوايا المتعددة أو الفيديوهات التي تتطلب سلاسة بصرية عالية.

وتعتمد الأداة في تصميمها على مراحل توليد منظمة، حيث تبدأ بإنشاء نقاط ارتكاز ثم تولد اللقطات النهائية على مراحل، وذلك لضمان الاتساق في المشهد.

تستهدف Stability AI من خلال هذا النموذج إتاحة حلول أكثر مرونة للمطورين والفنانين.

وهذا بالإضافة إلى تشجيع الأبحاث المستقبلية في مجال توليد الفيديو ثلاثي الأبعاد، خصوصًا مع تزايد الاهتمام بتجارب الواقع الافتراضي والمحتوى التفاعلي.

الجدير بالذكر أن الشركة، التي سبق أن طورت النموذج الشهير Stable Diffusion، تمر بفترة من التغييرات الداخلية بعد تعيين مدير تنفيذي جديد ودخول مخرج فيلم «تايتانيك» جيمس كاميرون في مجلس إدارتها، سعيًا لتعزيز موقعها في سوق الذكاء الاصطناعي.